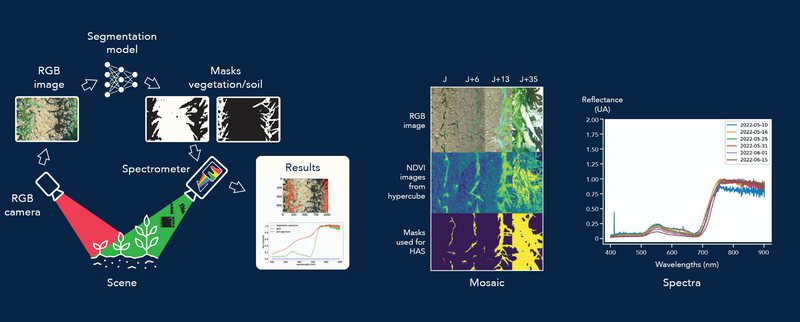

ONE-PIX, créé par POP Photonics Open Projects, c’est un kit open source de caméra hyperspectrale “single-pixel” où le Raspberry Pi joue le rôle de chef d’orchestre : il pilote la projection de motifs et synchronise les mesures du spectromètre pour reconstruire un “hypercube” d’images. Dans ce dossier , on va décortiquer le principe, l’architecture et ce que ça permet concrètement côté makers, avec, en bonus, la lecture “chercheurs” : limites, réglages, reproductibilité, pistes d’amélioration.

Au sommaire :

- 1 ONE-PIX : le Raspberry Pi au cœur d’une caméra hyperspectrale open source (makers & recherche)

- 1.1 ONE-PIX, l’ImVIA dès le départ, et un Raspberry Pi en rôle principal

- 1.2 Qu’est-ce que la spectrométrie ?

- 1.3 Principe d’un spectromètre (les briques) : l’exemple du Flame

- 1.4 ONE-PIX : le projet (la grande idée)

- 1.5 ONE-PIX version “communauté”

- 1.6 La version Pro : PRO-PIX

- 1.7 Usages makers : concret, démonstrable, reproductible

- 1.8 Les motifs projetés : pourquoi on voit souvent du “Hadamard”

- 1.9 intérêt pratique des motifs de Hadamard

- 1.10 Vidéo

- 1.11 Conclusion

- 1.12 Sources

ONE-PIX : le Raspberry Pi au cœur d’une caméra hyperspectrale open source (makers & recherche)

ONE-PIX, l’ImVIA dès le départ, et un Raspberry Pi en rôle principal

Au Creusot, avec l’ImVIA (Laboratoire Imagerie et Vision Artificielle), on aime les projets qui sortent du PowerPoint pour aller se frotter au réel : une manip qui se monte, qui se règle, qui produit des données… et qui, idéalement, peut être reproduite ailleurs. ONE-PIX coche exactement ces cases, avec un bonus qui parle directement aux lecteurs de Framboise314 : le Raspberry Pi n’est pas “un PC à côté”, il est au cœur du dispositif.

L’idée de départ est à la fois élégante et un peu contre-intuitive : faire de l’imagerie hyperspectrale (ou au minimum, une acquisition spectrale riche) sans passer par une caméra hyperspectrale hors de prix. ONE-PIX s’appuie sur le principe du single-pixel imaging : au lieu d’utiliser une matrice de détecteurs (un détecteur par pixel comme dans une caméra classique), on utilise un seul détecteur. L’information spatiale est obtenue en modulant l’éclairage de la scène avec une série de motifs structurés, puis l’image est reconstruite par calcul à partir des mesures successives.

En savoir plus →

Pourquoi ça mérite un dossier complet ici

Parce que ONE-PIX est typiquement le genre de projet qui fait le pont entre deux mondes : côté makers, on a un système open source, démontable, améliorable, documentable et montrable en atelier. Côté recherche (et donc ImVIA), on a un terrain de jeu sérieux : protocoles d’acquisition, calibration, reproductibilité, traitement du signal, constitution de jeux de données, et pistes d’optimisation. la Single Pixel Imaging (SPI) est une méthode d’imagerie relativement récente, avec encore beaucoup d’avancées scientifiques en cours.

Le kit permet donc également d’expérimenter et d’évaluer de nouvelles méthodes SPI (stratégies d’échantillonnage, bases de motifs, méthodes de reconstruction, etc.), certaines pouvant être plus efficaces ou offrir d’autres avantages selon les applications.

Et surtout, parce que le Raspberry Pi est dans son élément : orchestrer, synchroniser, piloter, enregistrer, automatiser, rendre la manip utilisable. Pas juste “héberger un script”, mais tenir un rôle de chef d’orchestre entre la projection de motifs, la mesure spectrale, la séquence d’acquisition et la production de données exploitables.

Ce que vous allez trouver dans ce dossier

On va commencer par les bases : c’est quoi la spectrométrie, comment fonctionne un spectromètre, puis le principe ONE-PIX et son architecture. Ensuite, on mettra les mains dans le concret : ce qu’on peut faire en mode maker, ce que la version Pro change vraiment, et enfin comment un labo comme l’ImVIA peut exploiter (et améliorer) ce type de dispositif.

On va commencer par les bases : c’est quoi la spectrométrie, comment fonctionne un spectromètre, puis le principe ONE-PIX et son architecture. Ensuite, on mettra les mains dans le concret : ce qu’on peut faire en mode maker, ce que la version Pro change vraiment, et enfin comment un labo comme l’ImVIA peut exploiter (et améliorer) ce type de dispositif.

Le fil rouge restera le même du début à la fin : où intervient le Raspberry Pi, pourquoi il est pertinent, et comment l’intégrer proprement dans une chaîne “terrain → données” reproductible.

Qu’est-ce que la spectrométrie ?

La spectrométrie, c’est l’art (et la science) de mesurer comment un objet interagit avec la lumière selon la longueur d’onde. Dit simplement : au lieu de dire “c’est clair / c’est sombre”, on regarde quelles couleurs précises (du visible jusqu’à l’infrarouge, selon le capteur) sont absorbées, réfléchies ou transmises.

Le résultat, c’est un spectre : une courbe qui devient une sorte de signature. Deux objets qui se ressemblent à l’œil peuvent avoir des signatures très différentes (et inversement). C’est pour ça que la spectrométrie est utilisée pour identifier ou différencier des matériaux : plastiques, pigments, encres, tissus, végétaux, contaminants…

Le point clé à retenir

Une photo “classique” donne 3 valeurs par pixel (R, G, B). La spectrométrie, elle, donne une information par longueur d’onde. Et quand on combine ça avec une dimension “image”, on arrive vers le multispectral / hyperspectral : pour chaque point, on ne mesure plus 3 couleurs… mais des dizaines voire des centaines de bandes.

Pourquoi c’est utile en pratique

Parce que ça permet d’aller au-delà du visuel : détecter une différence de matière, repérer une zone altérée, trier des objets proches, suivre l’état d’une surface, ou caractériser un échantillon de façon plus robuste qu’une simple image RGB. Exactement le genre de données “riches” qui intéressent autant les makers (démos, tri, analyse) que les chercheurs (protocoles, modèles, classification).

Principe d’un spectromètre (les briques) : l’exemple du Flame

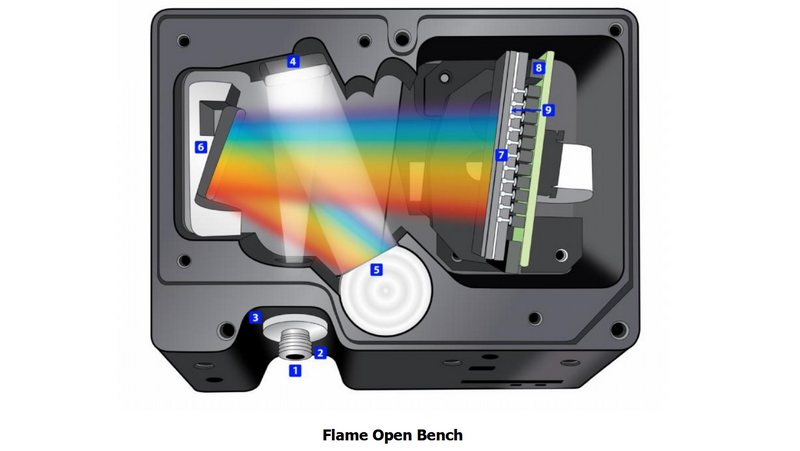

La figure ci-dessus illustre très bien le fonctionnement d’un spectromètre miniature de type Czerny-Turner : la lumière entre par une fibre, traverse une fente qui définit l’ouverture, est collimatée (rendue quasi parallèle), puis dispersée par un réseau de diffraction. Un second miroir refocalise ensuite le spectre sur un détecteur linéaire qui transforme la répartition des longueurs d’onde en signal numérique.

Trajet de la lumière (repères 1 à 9)

1 — Connecteur de fibre optique : la lumière arrive par une fibre et entre dans le banc optique via un connecteur SMA 905. Ce “bulkhead” fixe précisément la position de l’extrémité de fibre et des éléments d’entrée.

2 — Fente interchangeable : c’est l’ouverture d’entrée. Plus la fente est fine, meilleure est la résolution ; plus elle est large, plus on récupère de lumière (donc du signal).

3 — Filtre absorbant longpass (option) : si présent, il est placé entre la fente et l’ouverture dans le bulkhead SMA. Il sert à limiter la bande spectrale qui entre dans le spectromètre ou à équilibrer la réponse selon l’application. Ce filtre est associé à une configuration (et typiquement à un ensemble fente/bulkhead).

4 — Miroir collimatant : il transforme le faisceau divergent issu de la fente en faisceau quasi parallèle dirigé vers le réseau. Le manuel indique deux variantes : standard ou SAG+ (qui favorise le NIR mais absorbe fortement l’UV, utile notamment en fluorescence pour réduire certaines lumières parasites).

5 — Réseau de diffraction (grating) : c’est l’élément qui “sépare” la lumière en longueurs d’onde (le fameux arc-en-ciel). Le choix du réseau et son réglage déterminent la plage spectrale couverte et l’efficacité du système sur certaines longueurs d’onde.

6 — Miroir focalisant : il refocalise le spectre (ordre 1) sur le plan du détecteur. Comme le miroir collimatant, il peut être en version standard ou SAG+ selon les besoins.

7 — Lentille de collecte du détecteur (option) : c’est une lentille cylindrique fixée côté détecteur. Elle “ramène” la lumière issue d’une fente haute vers les éléments plus courts du capteur, ce qui améliore le rendement et réduit la lumière parasite. Les modèles préconfigurés avec cette lentille portent souvent le suffixe “-ES”.

8 — Détecteur : le Flame utilise un capteur linéaire (1D). Selon la version : 2048 pixels (FLAME-S, Sony ILX511B) ou 3648 pixels (FLAME-T, Toshiba TCD1304AP). Chaque pixel correspond à une bande de longueurs d’onde ; le signal analogique est numérisé (ADC) puis envoyé au logiciel via USB.

9 — Filtre “order-sorting” longpass variable (option) : il sert à bloquer les effets d’ordres 2 et 3 du réseau (des longueurs d’onde “indésirables” pouvant se superposer et fausser la mesure). L’objectif est de réduire la lumière parasite et d’améliorer la fidélité de la réponse spectrale, en particulier selon la plage choisie et la fenêtre du détecteur.

ONE-PIX : le projet (la grande idée)

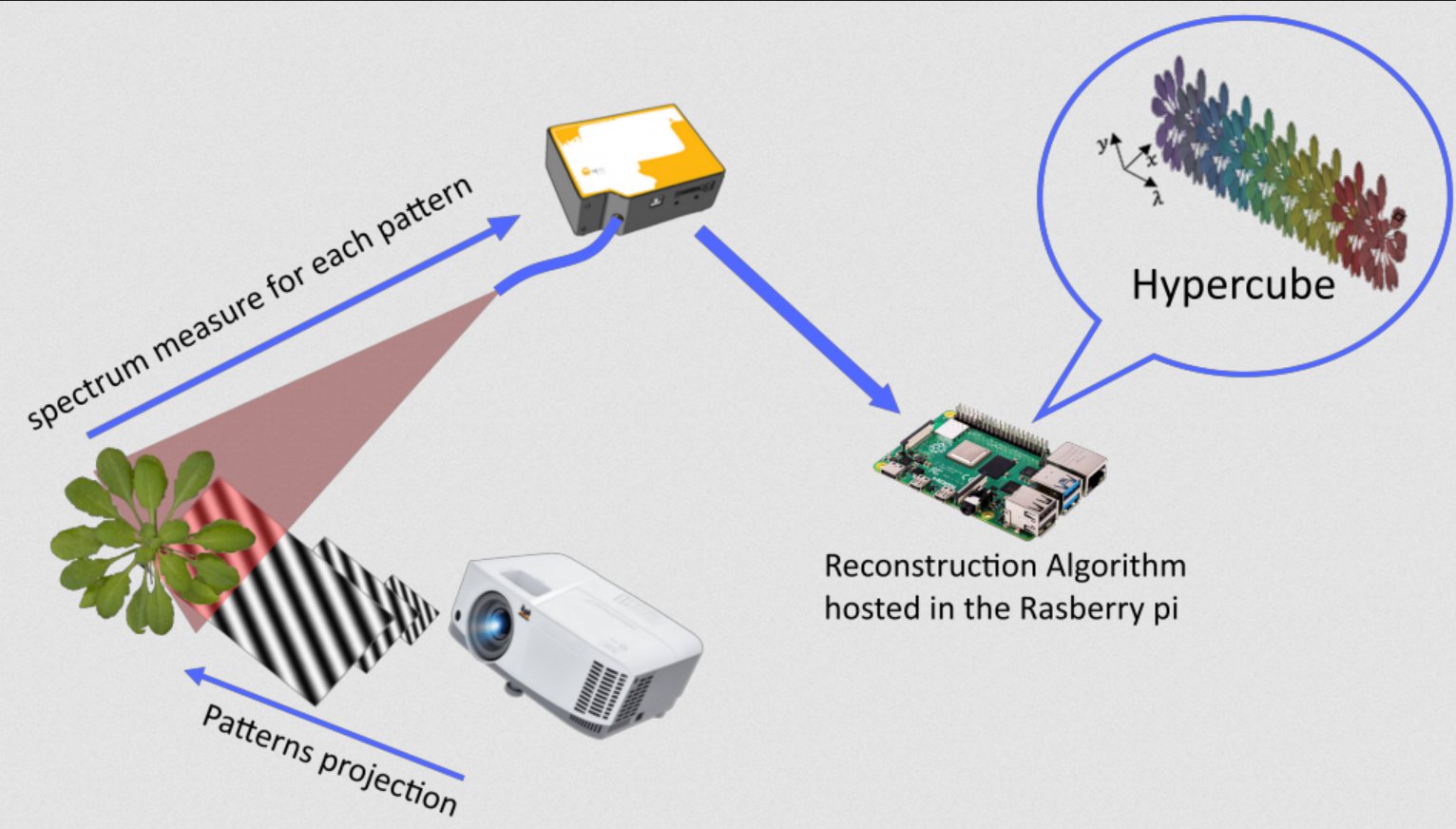

ONE-PIX part d’une idée simple, mais redoutablement efficace : au lieu de capturer une image avec une caméra “classique” (un capteur 2D), on va éclairer la scène avec une série de motifs… et mesurer, à chaque fois, la réponse avec un spectromètre. L’intelligence du système, c’est que l’on ne récupère pas “une image” directement : on récupère une suite de mesures, puis on reconstruit l’information spatiale et spectrale par calcul.

Autrement dit : ONE-PIX remplace une caméra hyperspectrale coûteuse par un trio projecteur + spectromètre + calcul, avec un Raspberry Pi qui pilote l’ensemble et exécute l’algorithme de reconstruction.

Projection de motifs : “coder” la scène avec de la lumière

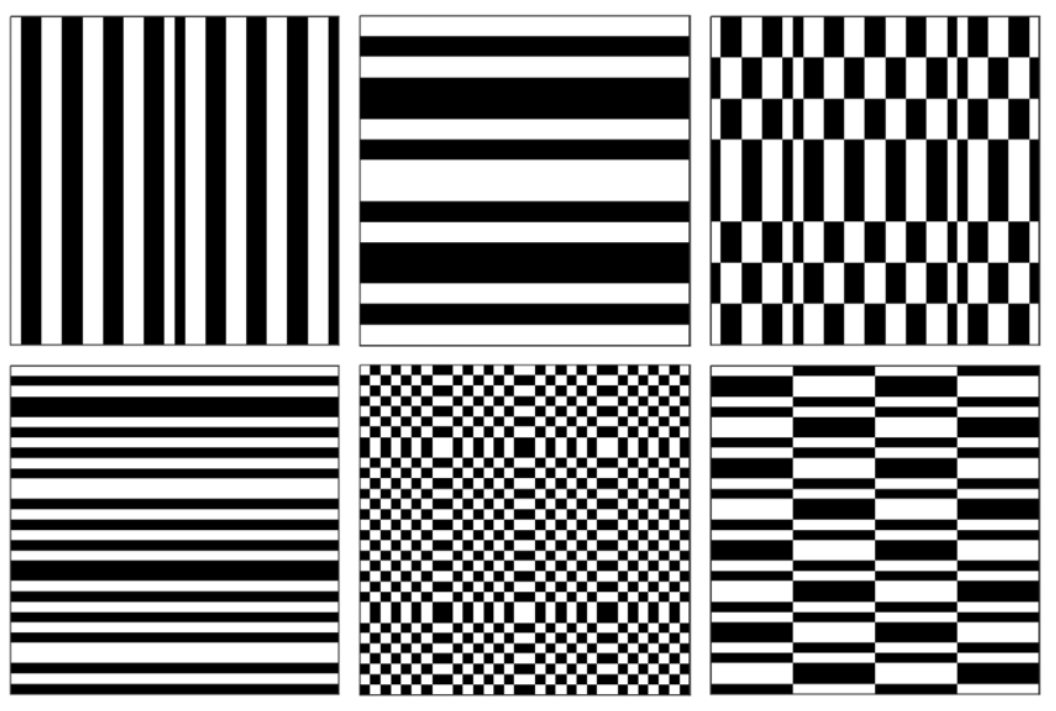

Le projecteur n’affiche pas une « vraie » image : il projette une série de motifs (souvent des motifs structurés). Les motifs sont toujours structurés, mais ils ne sont pas forcément binaires.

Certaines bases, comme Hadamard, sont binaires, mais d’autres comme Fourier contiennent des valeurs continues (niveaux de gris).

Chaque motif éclaire différemment la scène. La scène “répond” à ce motif, et c’est cette réponse que l’on va mesurer. Plus on projette de motifs, plus on acquiert d’informations, ce qui permet généralement d’obtenir une reconstruction avec une résolution spatiale plus élevée… au prix d’un temps d’acquisition plus long.

Un spectre par motif : la mesure “single-pixel”

À chaque motif projeté, le spectromètre ne voit pas une image : il mesure un spectre global correspondant à la lumière reçue (souvent via une fibre) pendant ce motif. On obtient donc une série de spectres : un spectre pour le motif n°1, un autre pour le motif n°2, etc. L’ensemble forme une table de mesures qui contient, indirectement, l’information de la scène.

Le Raspberry Pi au centre : pilotage, synchronisation, reconstruction

Le Raspberry Pi joue un rôle clé à trois niveaux :

- Pilotage : enchaîner les motifs projetés, gérer la séquence d’acquisition.

- Synchronisation : associer chaque spectre au bon motif (et au bon timing).

- Reconstruction : transformer la table de mesures en un résultat exploitable : une image (ou plutôt une pile d’images) selon les longueurs d’onde.

C’est exactement ce qui fait l’ADN ONE-PIX : le Raspberry Pi n’est pas un accessoire. C’est le cerveau qui transforme une manip optique en données utilisables.

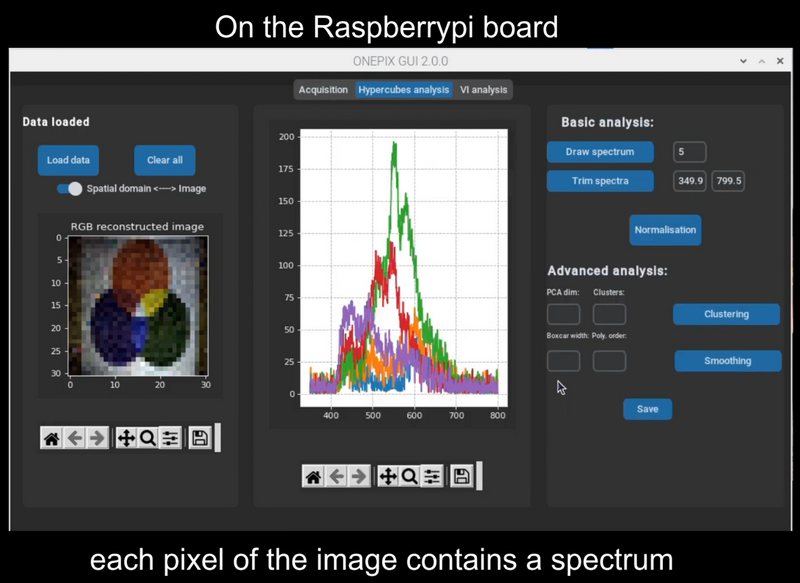

L’hypercube : une image… où chaque pixel contient un spectre

Le résultat final n’est pas une simple photo. ONE-PIX reconstruit un hypercube : pour chaque position (x, y) de l’image, on dispose d’un spectre selon la longueur d’onde (λ). On peut alors :

- afficher une image à une longueur d’onde donnée,

- extraire le spectre d’un point ou d’une zone,

- comparer des matériaux, faire de la classification, détecter des différences invisibles en RGB.

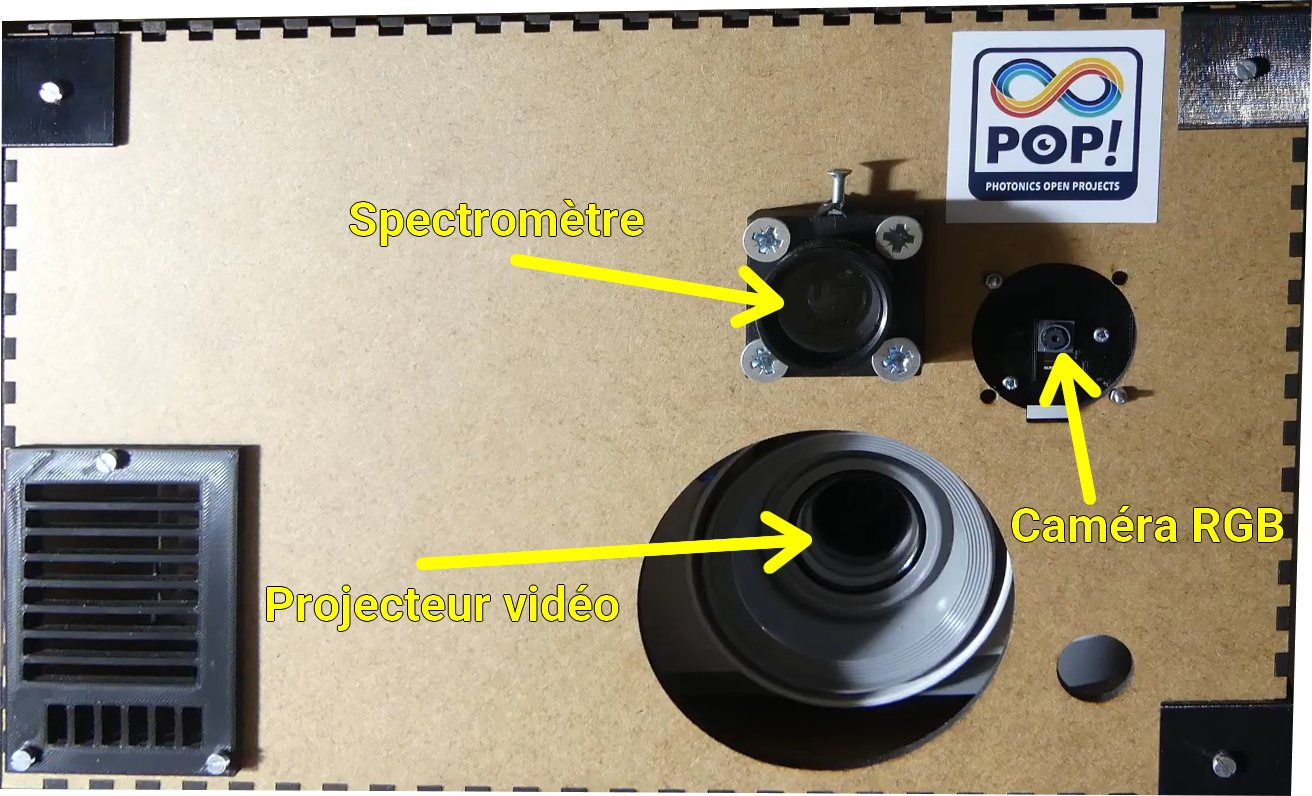

Et la caméra RGB, dans tout ça ?

Selon les montages, une caméra RGB peut être intégrée pour fournir une vue “classique” de la scène : cadrage, repérage de zones, visualisation rapide et comparaison avec les résultats reconstruits. Elle ne remplace pas la partie spectrale : elle apporte surtout une référence visuelle pratique côté usage (makers) et côté protocole (recherche).

ONE-PIX version “communauté”

La force de ONE-PIX, côté “communauté”, c’est que tout est public, accessible et modifiable : le code, la documentation, et une organisation pensée pour que l’on puisse reproduire le système, puis l’adapter à son besoin (nouveau spectromètre, autre projecteur, variantes d’acquisition, traitements…). Pour un maker, c’est exactement ce qu’on veut : un projet qui ne se contente pas d’une démo, mais qui donne les clés.

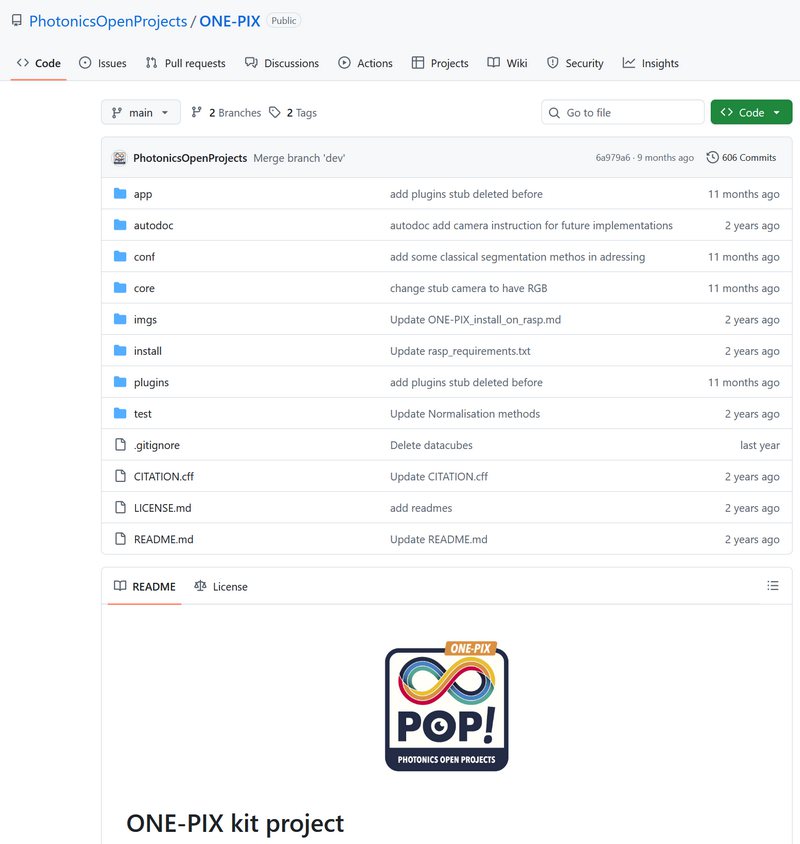

Un dépôt GitHub structuré (et ça compte)

Le dépôt officiel n’est pas juste un zip et puis dém… débrouilles-toi : il est organisé en briques identifiables (application, cœur, plugins, installation, ressources). Cette structure est importante, car elle montre que le projet est pensé pour évoluer : on peut installer, tester, puis comprendre progressivement où intervenir sans tout casser.

Autre point appréciable : la documentation est intégrée au dépôt. Pour un projet optique/logiciel, ce n’est pas un détail. Entre la partie acquisition (synchronisation des motifs et des mesures) et la reconstruction (calcul), on a vite fait de se perdre si les consignes ne sont pas clairement posées.

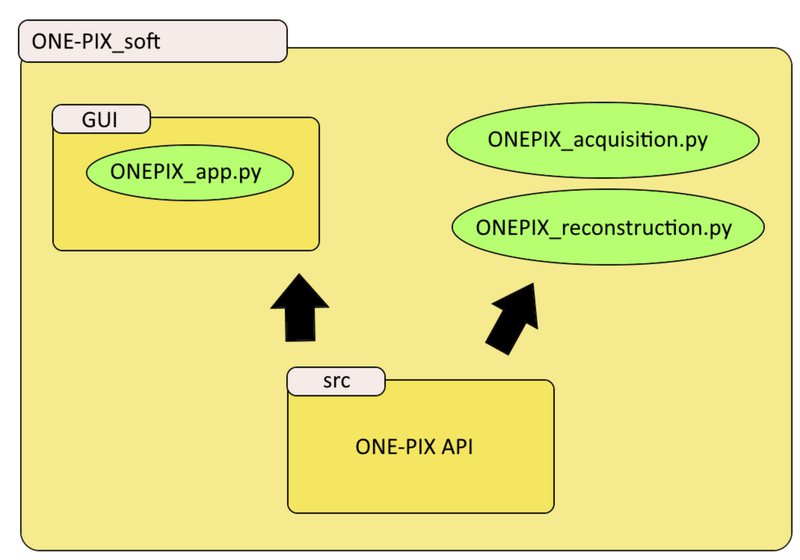

Organisation logicielle : GUI, API et modules dédiés

ONE-PIX est construit de manière assez “propre” pour être compris et étendu. On retrouve :

- une interface graphique (GUI) qui permet de piloter le système sans tout faire en ligne de commande ;

- une API ONE-PIX (dans

src) qui centralise les fonctions communes et évite de dupliquer du code partout ; - des modules séparés pour les tâches clés : acquisition (

ONEPIX_acquisition.py) et reconstruction (ONEPIX_reconstruction.py).

Cette séparation n’est pas qu’une coquetterie : elle rend le projet plus facile à maintenir et à faire évoluer. En pratique, cela permet par exemple de modifier la façon dont on acquiert les mesures (timings, séquences, types de patterns) sans réécrire toute la partie reconstruction, et inversement.

Plugins : ouvrir la porte aux variantes matérielles

Un point très “maker-friendly” est la présence d’une logique de plugins. Dans un projet comme ONE-PIX, c’est crucial : selon le spectromètre utilisé, les interfaces, les pilotes et parfois même certains paramètres de mesure changent. Avoir une structure prévue pour intégrer de nouveaux périphériques évite de transformer le code en plat de spaghetti dès qu’on sort du montage “référence”.

Ce que cela implique côté Raspberry Pi

Dans cette version communauté, le Raspberry Pi reste la pièce maîtresse : il héberge l’application, pilote la séquence d’acquisition, gère le stockage des mesures, et exécute la reconstruction. C’est important pour l’esprit ONE-PIX : on n’est pas obligé d’avoir une station de travail pour “faire tourner la démo”. Le Pi sert de plateforme autonome, compacte, et parfaitement à sa place pour orchestrer un montage optique.

À quoi s’attendre : reproductible, mais pas “plug and play”

Dernier point à dire franchement : open source ne veut pas dire magique. Reproduire ONE-PIX demande un minimum de rigueur (alignement optique, stabilité, contrôle de la lumière ambiante, calibration). En revanche, la version communauté fournit une base solide : une architecture claire, des scripts séparés par rôle, et une organisation qui facilite les itérations. C’est exactement ce qu’on attend d’un projet qui peut vivre en FabLab… et intéresser un labo.

La fiche détaillée one-pix est disponible en téléchargement.

La version Pro : PRO-PIX

ONE-PIX est pensé pour apprendre, expérimenter et développer des méthodes. PRO-PIX, lui, vise l’étape d’après : une caméra hyperspectrale orientée usage professionnel, avec une priorité annoncée sur la performance, la flexibilité et la robustesse, tout en restant dans l’ADN “open innovation” du projet.

Ce que PRO-PIX ajoute par rapport à ONE-PIX

Le positionnement est clair : PRO-PIX est présenté comme une solution plus “terrain” et plus durable, conçue pour des cas d’usage variés en visible et proche infrarouge (NIR). Le mot clé, c’est la reconfigurabilité : l’objectif est d’adapter la caméra à l’application, plutôt que d’imposer un fonctionnement unique.

- Robustesse : pensée pour supporter des conditions d’usage plus exigeantes (environnement, contraintes terrain).

- Reconfigurabilité matérielle : possibilité d’adapter certains éléments/“accessoires” selon le contexte de mesure.

- Reconfigurabilité logicielle : réglages et paramètres ajustables pour viser une plage spectrale, une scène et un compromis résolution/vitesse adaptés.

Technologie : hyperspectral “compressif”

Comme ONE-PIX, PRO-PIX s’appuie sur une approche de compressive sensing : l’idée n’est pas seulement de “mesurer plus”, mais de mesurer mieux ce qui est utile pour l’application (et d’optimiser le compromis précision / vitesse / volume de données). Cette logique colle bien aux besoins industriels : on veut des mesures actionnables, pas forcément un cube géant à chaque acquisition.

Open innovation : du kit abordable vers un capteur hautes performances

Le message intéressant, et assez rare dans ce domaine : l’approche proposée consiste à développer ses méthodes (protocoles, traitement, algorithmes) avec ONE-PIX, puis à transférer ce travail vers un capteur PRO-PIX plus performant. Autrement dit, ONE-PIX sert de rampe de lancement “reproductible”, et PRO-PIX de plateforme de déploiement.

À qui s’adresse PRO-PIX ?

PRO-PIX vise des usages où l’on a besoin d’un système fiable, paramétrable et prêt à être intégré : agriculture de précision, agroalimentaire, géologie, santé… bref, des domaines où l’hyperspectral devient une brique de décision plutôt qu’une simple démo de labo.

Un point à noter : support et accompagnement

Le discours met aussi en avant une dimension “produit” : assistance sur la configuration, l’exploitation et l’interprétation des données. Pour un usage professionnel, c’est souvent aussi important que la fiche technique : une caméra hyperspectrale sans méthode ni accompagnement, c’est un bel objet… qui finit au placard.

La fiche détaillée pro-pix est disponible en téléchargement.

Usages makers : concret, démonstrable, reproductible

Le gros intérêt de ONE-PIX côté makers, c’est qu’on peut faire de l’hyperspectral (ou du “quasi-hyperspectral” selon la config) sans matériel de labo hors de prix, et surtout avec une chaîne complète : acquisition, reconstruction, visualisation et premières analyses. C’est typiquement le genre de système qui se prête à la fois à la démo qui claque en FabLab… et à des mini-projets structurés, où l’on apprend vraiment quelque chose.

Démo “wow” (simple et efficace)

Le principe qui marche bien en animation : prendre deux objets qui se ressemblent à l’œil (ou sous éclairage “normal”), et montrer que leur signature spectrale diffère. Cela peut être :

- deux plastiques proches (ou deux filaments) ;

- deux encres/pigments très similaires ;

- des tissus dont la teinte paraît identique, mais dont la composition ou le traitement diffère.

Le point pédagogique est immédiat : une image RGB ne voit que 3 canaux, alors qu’ici on accède à une information “par longueurs d’onde”. Et c’est là que l’on comprend pourquoi “voir” et “mesurer” sont deux métiers différents.

Mini-projets makers (qui ne finissent pas au fond d’un tiroir)

Voici des pistes très “atelier”, avec un objectif clair et un résultat exploitable :

1) Classifier 3 matériaux

Choisir trois familles bien distinctes (par exemple : plastique A / plastique B / papier), acquérir plusieurs échantillons, puis comparer les spectres et tester une classification simple. Objectif : comprendre la variabilité, l’importance de la calibration, et les limites d’un modèle “trop optimiste”.

2) Cartographier une zone (une “carte” d’un matériau)

Sur une scène simple (un patchwork de matériaux, une feuille de test, un assemblage), reconstruire un hypercube et produire une carte : “où est le matériau X ?”. Objectif : passer de la courbe (spectre) à une information spatiale utile.

3) Comparer deux états d’une surface

Sans promettre des miracles, on peut comparer deux états d’un même objet (avant/après, sec/humide, propre/encrassé) et observer ce qui bouge dans le spectre. Objectif : comprendre ce que l’on détecte réellement (et ce que l’on ne détecte pas).

Le montage “maker-friendly” : stabilité, lumière, répétabilité

En hyperspectral, le diable se cache dans la lumière. Pour des résultats propres, trois règles pratiques valent de l’or :

- Stabilité : la scène ne doit pas bouger pendant la séquence de motifs (sinon, la reconstruction se dégrade).

- Lumière ambiante contrôlée : travailler dans un caisson / une enceinte, ou au minimum dans un environnement stable et répétable.

- Calibration : prévoir systématiquement une référence “noir” et une référence “blanc” (même simples) pour éviter de comparer des mesures “faussées” par l’éclairage.

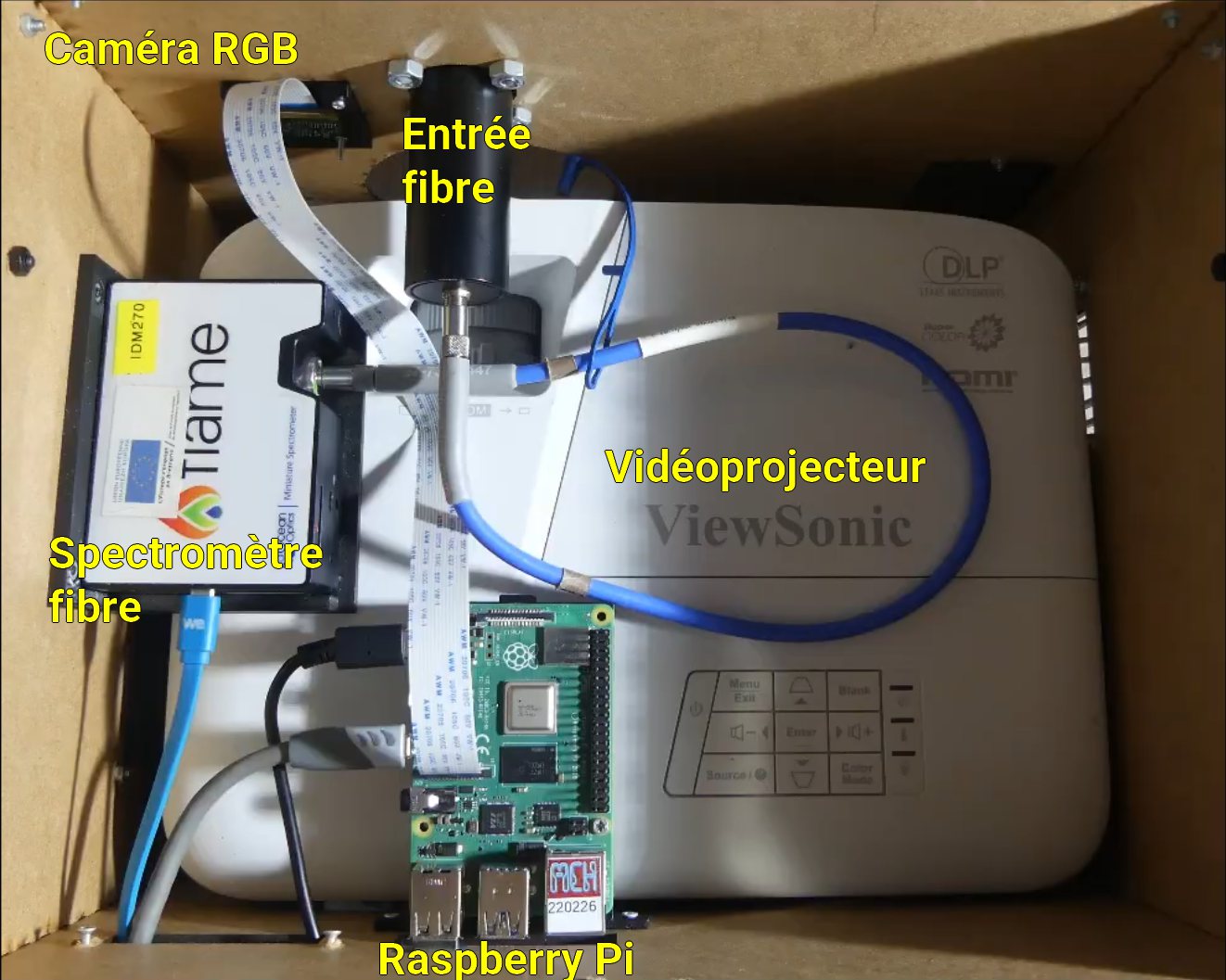

Montage ONE-PIX en caisson : le projecteur affiche les motifs sur la scène ; en face, le module de mesure (spectromètre via fibre) et le Raspberry Pi assurent l’acquisition synchronisée et la reconstruction.

La caméra RGB : utile, mais pas le cœur du sujet

Quand une caméra RGB est présente, elle sert surtout de repère visuel : cadrage, suivi de la scène, documentation, comparaison “avant/après”. Elle ne remplace pas l’hyperspectral : elle aide à interpréter et à présenter les résultats, ce qui est précieux en contexte makers (et encore plus quand on veut expliquer la manip au public).

Pourquoi le Raspberry Pi est à sa place ici

ONE-PIX n’est pas juste “un montage optique”. C’est une chaîne instrumentée : affichage des motifs, synchronisation, acquisition, stockage, reconstruction, visualisation. Le Raspberry Pi est parfaitement adapté à ce rôle de chef d’orchestre : compact, autonome, facile à déployer en atelier, et suffisamment puissant pour faire tourner une interface et des traitements raisonnables sans dépendre d’un PC de course.

Les motifs projetés : pourquoi on voit souvent du “Hadamard”

« Pourquoi utilise-t-on souvent les motifs de Hadamard ? Ce n’est pas tant pour leur orthogonalité (que l’on retrouve aussi chez Fourier ou la DCT), mais pour leur nature binaire (-1 / +1). La plupart des vidéoprojecteurs utilisent la technologie DMD (micromiroirs ON/OFF). Comme les motifs de Hadamard sont binaires, le projecteur peut les afficher directement et très rapidement. À l’inverse, des motifs de Fourier nécessiteraient de simuler des niveaux de gris, ce qui ralentirait l’acquisition. Sur ONE-PIX, même si la vitesse pure n’est pas encore le facteur limitant, c’est une base solide pour l’expérimentation scientifique. »

intérêt pratique des motifs de Hadamard

Si Hadamard est la « star » du Single Pixel Imaging, ce n’est pas parce qu’il surclasse mathématiquement les autres bases (comme Fourier ou DCT), mais pour des raisons de mise en œuvre technique :

-

Adaptation au matériel (DMD) : L’atout majeur est leur caractère binaire. Les vidéoprojecteurs modernes utilisent des matrices de micromiroirs (DMD) qui ne connaissent que deux états : ON ou OFF. Les motifs de Hadamard s’y affichent nativement à très haute vitesse, là où d’autres bases nécessiteraient des calculs d’approximation pour gérer les niveaux de gris.

-

Simplicité de calcul : Bien que la FFT (Fast Fourier Transform) soit extrêmement optimisée aujourd’hui, la transformée de Hadamard reste très légère, ce qui est toujours un bonus pour un traitement fluide sur un système embarqué comme le Raspberry Pi.

-

Gestion du monde réel (Le différentiel) : Théoriquement, Hadamard utilise des valeurs +1/-1. Comme un projecteur ne projette pas de « lumière négative », on utilise une méthode différentielle :

-

On projette un motif M (valeurs 1 et 0).

-

On projette son complémentaire (on inverse le noir et le blanc).

-

On fait la différence entre les deux mesures.

-

Le bénéfice caché : Cette double mesure permet de s’affranchir de la lumière ambiante et des dérives électroniques lentes. Ce qui est présent dans les deux captures (le bruit de fond de la pièce) s’annule lors de la soustraction.

Et si on ne projette pas tous les motifs ?

Projeter toute la base Hadamard donne la reconstruction la plus fidèle… mais peut être long. En pratique, on peut n’en projeter qu’une partie (ou choisir un ordre “du plus grossier au plus fin”) pour obtenir une image plus rapidement, quitte à accepter une résolution ou un niveau de détail plus limité. C’est là qu’on touche au compromis central du single-pixel imaging : temps d’acquisition vs qualité de reconstruction.

Vidéo

Conclusion

L’imagerie hyperspectrale, sur le papier, fait rêver. Dans la vraie vie, elle se heurte vite à un mur très concret : le coût des instruments. Rien qu’un spectromètre “compact” de type Flame (ou équivalent) représente un budget qui, dans beaucoup de cas, réserve ce genre d’approche aux laboratoires universitaires et aux structures bien équipées.

Et c’est précisément pour cela que ONE-PIX est intéressant : il montre qu’on peut aborder ce domaine autrement, avec une architecture plus accessible, plus ouverte, et surtout reproductible. On ne “démocratise” pas la physique en claquant des doigts, mais on rend l’expérimentation et l’apprentissage beaucoup plus abordables qu’avec une caméra hyperspectrale clé en main.

Dans cette approche, le Raspberry Pi n’est pas là pour faire joli : il a toute sa place. Il sert de chef d’orchestre entre la projection des motifs, la mesure spectrale, l’enregistrement des données et la reconstruction. Compact, autonome, facile à déployer, il permet de transformer un montage optique en un système cohérent, utilisable, et documentable et c’est cette approche que j’ai appréciée.

Il y a un point qui mérite d’être dit clairement : un montage de ce type peut être à portée d’un FabLab… à condition de jouer intelligemment la carte de la collaboration. Un FabLab apporte la mécanique, l’intégration, la capacité à prototyper vite et à documenter. Un labo universitaire apporte l’instrumentation, la méthode, la calibration et le recul scientifique. Les deux ensemble, c’est souvent le meilleur des deux mondes.

Au final, ONE-PIX ne remplace pas les solutions professionnelles, et ce n’est pas son objectif. Mais il ouvre une porte : celle d’un hyperspectral plus “terrain”, plus pédagogique, et plus proche de ce que makers et chercheurs aiment vraiment… comprendre, mesurer, améliorer.

Sources

https://wejn.org/assets/2025-spec-calibration-fail/FLAME-S-VIS-NIR-ES-manual.pdf

https://github.com/PhotonicsOpenProjects/ONE-PIX/tree/main

https://www.avantes.com/support/theoretical-background/introduction-to-spectrometers/

https://wejn.org/2025/07/failing-to-calibrate-flame-s-vis-nir-es/

https://math.uni.lu/eml/assets/reports/2021/hadamard.pdf